นักวิจัยจาก University of California, San Francisco (UCSF) พัฒนาอุปกรณ์สร้างเสียงพูดสังเคราะห์โดยอาศัยการอ่านคลื่นสมองของผู้ใช้ ช่วยให้ผู้ป่วยที่มีปัญหาในการพูด สามารถสื่อสารได้โดยใช้อุปกรณ์นี้พูดแทนปากของตนเอง

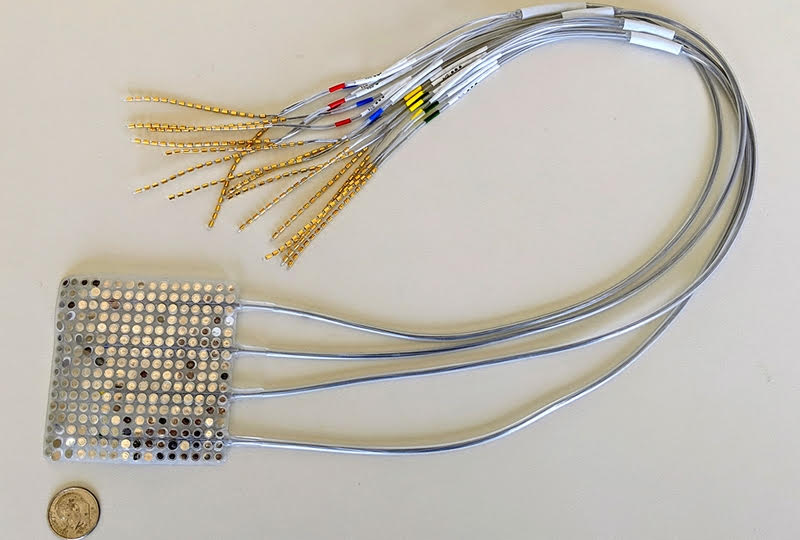

อุปกรณ์นี้มีแผงขั้วไฟฟ้ารูปสี่เหลี่ยมจัตุรัสที่มีขนาดด้านละประมาณ 6.5 เซนติเมตร มีขั้วไฟฟ้าทั้งหมด 256 จุดที่จะต้องปลูกถ่ายเพื่อใช้สำหรับอ่านคลื่นไฟฟ้าจากสมองโดยตรง จากนั้นจึงจะนำเอาสัญญาณที่อุปกรณ์อ่านได้มาแปลผลแล้วสังเคราะห์เสียงพูดแทนผู้ใช้

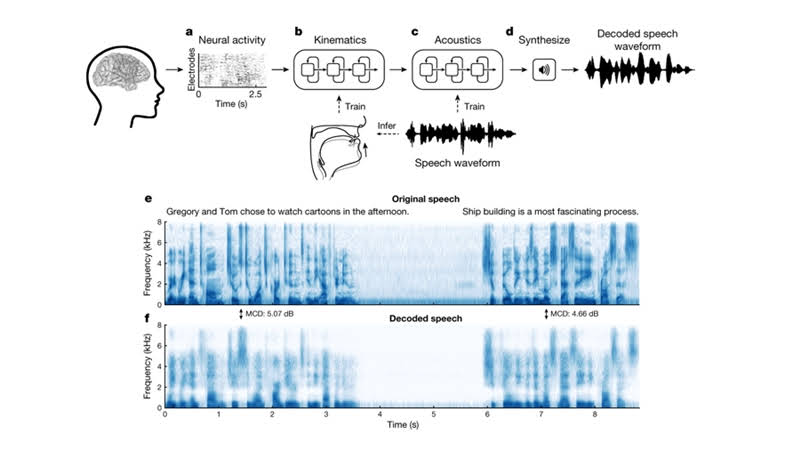

สัญญาณคลื่นไฟฟ้าที่อุปกรณ์อ่านได้นั้นเป็นสัญญาณที่เชื่อมโยงกับการควบคุมการเคลื่อนไหวและทำงานของอวัยวะเพื่อการพูดอย่าง ไม่ว่าจะเป็นการขยับกราม, ริมฝีปาก, ลิ้น และกล่องเสียง โดยโครงข่ายประสาทเทียมที่ได้รับการฝึกให้รู้จำรูปแบบคลื่นสัญญาณไฟฟ้าจากสมองจะทำการถอดรหัสเพื่อให้เข้าใจว่าผู้ใช้ต้องการเปล่งเสียงพูดอย่างไร

จากนั้นโครงข่ายประสาทเทียมอีกชุดหนึ่งจะทำหน้าที่สังเคราะห์เสียงพูดให้สัมพันธ์กับผลการแปลสัญญาณที่ได้ โดยอุปกรณ์ของทีมวิจัยจาก UCSF นี้สามารถแปลงสัญญาณคลื่นไฟฟ้าจากสมองเป็นเสียงพูดได้ราว 150 คำต่อนาที เป็นความเร็วในระดับเดียวกันกับการพูดสนทนาตามธรรมชาติ

ทีมวิจัยได้ทดลองปลูกถ่ายอุปกรณ์ต้นแบบของพวกเขากับผู้ป่วยโรคลมชักจำนวน 5 ราย แล้วให้ผู้ป่วยที่ร่วมการวิจัยทดลองอ่านประโยคภาษาอังกฤษที่ถูกคัดเลือกมาเพื่อให้ผู้ป่วยได้พูดออกเสียงครอบคลุมรูปแบบการออกเสียงของภาษาอังกฤษทั้งหมด จากนั้นจึงนำเอาสัญญาณที่ได้ไปเข้ากระบวนการเพื่อสังเคราะห์เสียงพูดและทดสอบว่าผู้อื่นสามารถฟังเสียงสังเคราะห์นั้นได้เข้าใจหรือไม่ ซึ่งแม้ว่าเสียงพูดสังเคราะห์ที่ได้นี้อาจมีบางคำที่ออกเสียงไม่ชัดหรือผิดพลาดอยู่บ้าง แต่เมื่อฟังเป็นประโยคแล้วก็พอจะสามารถเข้าใจคำพูดได้

จากประโยคภาษาอังกฤษที่นำมาใช้ในการวิจัยทดลองจำนวน 101 ประโยค ผู้ร่วมการวิจัยในฐานะผู้ฟังประโยคเสียงสังเคราะห์สามารถเข้าใจเสียงพูดได้ถูกต้องราว 70% ของจำนวนคำทั้งหมด โดยทีมวิจัยตั้งเป้าที่จะพัฒนาเสียงสังเคราะห์ให้มีความเป็นธรรมชาติมากยิ่งขึ้น

ปัจจุบันนี้มีงานวิจัยจำนวนมากเกี่ยวกับ BCI (Brain-Computer Interfaces) ซึ่งหมายถึงเทคโนโลยีคอมพิวเตอร์ที่เชื่อมต่อกับสมองมนุษย์โดยตรง โดยส่วนใหญ่เน้นงานพัฒนาเพื่อใช้งานกับผู้ป่วยที่มีปัญหาด้านการสื่อสารในวิธีการปกติ เช่นเดียวกับผลงานต้นแบบอุปกรณ์สร้างเสียงพูดสังเคราะห์ของทีมวิจัยจาก UCSF นี้ โดยในปี 2012 ก็เคยมีงานวิจัยของ University of California, Berkeley สร้างอุปกรณ์อ่านคำพูดจากคลื่นไฟฟ้าสมองเช่นกัน โดยต่างกันที่งานวิจัยในตอนนั้นใช้วิธีการเรียนรู้รูปแบบคลื่่นสัญญาณเชื่อมโยงกับคำ

Edward Chang ศัลยแพทย์ประสาทของ UCSF หัวหน้าทีมวิจัยนี้อธิบายว่าที่ผ่านมาส่วนใหญ่นั้นงานวิจัยเรื่องการแปลคลื่นไฟฟ้าจากสมองเป็นคำพูดมักจะพยายามมุ่งเน้นหารูปแบบเฉพาะของคลื่นที่สื่อถึงคำแต่ละคำ ซึ่งนั่นเป็นสิ่งที่ยากมาก (อาจเป็นเพราะคำในภาษาอังกฤษนั้นมีมากมายจนยากที่จะให้ระบบคอมพิวเตอร์แยกแยะจำแนกรู้จักรูปแบบคลื่นสัญญาณที่ใช้แทนคำต่างๆ ได้หมด) พวกเขาจึงเลือกใช้การหาความเชื่อมโยงของรูปแบบคลื่นสัญญาณกับการควบคุมอวัยวะเพื่อการออกเสียงพูดซึ่งเปรียบเสมือนองค์ประกอบพื้นฐานที่จะสามารถนำมาผสานกันออกมาเป็นคำพูดได้แทน

ที่มา - IEEE Spectrum, เอกสารงานวิจัย

Comments

ใช้ WaveNet ด้วยไหม

ใช้ Misaka Network แปลคลื่นไฟฟ้าจากสมองเป็นคำพูดสิครับ

/me ชายหัวหงอกแนะนำ :P

จตุรัส => จัตุรัส