ยังไม่ได้ของจริง แน่นอนผมจั่วหัวมาแบบนี้ เพราะผมอ่าน spec มาพูดในเชิงคนถ่ายรูปล้วนๆ จากการที่ได้ใช้งานกล้องถ่ายรูปมาได้สักเกือบๆ 4 ปีแล้ว

ทำความเข้าใจร่วมกันก่อนว่า การถ่ายรูปหรือการเก็บภาพลงบนสื่อใดๆ คือ “การเก็บแสงที่สะท้อนเข้าตาเรา โดยที่เราแทนที่ตาเราด้วย เลนส์ และ Image Sensor มีสมองเป็นตัวประมวลผลภาพ ซึ่งเราให้ Image Processor เป็นตัวแทน” เพราะฉะนั้นแสงยิ่งสว่าง หรือมีแสงเพียงพอต่อการถ่ายรูปจะยิ่งดี

เพราะฉะนั้น ผมของแยกออกมาเป็น 3 ส่วนคือ เลนส์, Image Sensor และ Image Processor

คำเตือน! … ต่อจากนี้ Keyword เพียบ คนอ่านอาจธาตุไฟเข้าแทรกได้ แนะนำให้เตรียมตัวรับและหาคำตอบจาก Keyword บางตัวเองนะครับ เป็นศัพท์เทคนิคล้วนๆ ใครอ่านแล้วเข้าใจเกือบหมดแสดงว่าถ่ายรูปมาพอสมควร

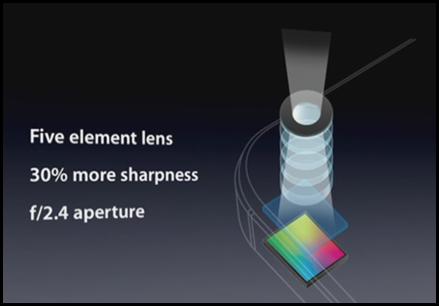

เลนส์ของกล้อง iPhone 4S เป็นชิ้นเลนส์ 5 ชิ้นมาประกอบกันเป็นชุดเลนส์ 1 ชุด (Five element lens) จากของเดิมใน iPhone 4 เป็น 4 ชิ้นเลนส์ ซึ่งในความเป็นจริงๆ ปรกติเลนส์ของกล้องถ่ายรูปนั้นจะมีชิ้นเลนส์หลายๆ ชิ้นมาประกอบกันเพื่อโฟกัสและรวมแสงเข้า Image Sensor อยู่แล้ว แต่อยู่ที่ว่าจะใส่กี่ชิ้นและจัดระยะห่างกันอย่างไร การเพิ่มชิ้นเลนส์ตามความเข้าใจคนทั่วไป อาจจะมองว่าอาจทำให้แสงเดินทางผ่านตัวกลางเพิ่มขึ้นจนทำให้คุณภาพของแสงที่วิ่งผ่านเข้าสูง Image Sensor ลดลง แต่ในความเป็นจริง การเพิ่มชิ้นเลนส์อาจเพื่อแก้ไขปัญหา หรือเพื่อทำให้แสงที่เดินทางผ่านเข้ามานั้นมีคุณภาพที่ดีขึ้นได้ อาจจะเพื่อบีบแสงให้รวมกลุ่มกันดีมากขึ้นไม่ให้ฟุ้ง หรือลดแสงสะท้อนต่างๆ (คล้ายๆ กับการเพิ่มชิ้นเลนส์ ED ของ Nikon ที่ลดความคลาดแสง หรือเพิ่มชิ้นเลนส์ Nano Coating เพื่อลดการเกิดแสงโกสหรือแฟร์ เป็นต้น) เพราะฉะนั้นการเพิ่มชิ้นเลนส์อาจจะหมายถึงคุณภาพของแสงที่วิ่งเข้ามาดีขึ้น ขจัดแสงที่ไม่พึงประสงค์ออกไปทำให้ภาพดูชัดและคมมากขึ้น

เมื่อตัวชิ้นเลนส์ที่มีตัวกลางเพิ่มขึ้น แม้จะช่วยได้มากในการรวมแสงที่มีคุณภาพดีขึ้น แต่ก็ยังมีปัญหาว่าในสภาพของแสงที่น้อย การเพิ่มรูรับแสง (Aperture) ให้ได้คุณภาพดีนั้นก็ยังเป็นสิ่งจำเป็น ผมมองว่าไหนๆ ก็ไหนๆ แล้วก็เลยเพิ่มขนาดความกว้างของรูรับแสงใน iPhone 4S กว้างขึ้นเป็น f/2.4 จาก f/2.8 ใน iPhone 4 จึงทำให้ชดเชยสิ่งที่เสียไปด้วยอีกทางเช่นกัน

ข้อสังเกตอย่างนึงก็คือ เลนส์ iPhone 4 แต่เดิมนั้นมีทางยาวโฟกัส (Focal length) ที่ 3.85mm แต่ใน iPhone 4S ปรับให้แคบลงมาเป็น 4.3mm ซึ่งทำให้ถ่ายรูปออกมาแล้วรู้สึกว่าถ่ายได้พื้นที่สำหรับเก็บภาพที่กว้างน้อยลง (ทางยาวโฟกัสเพิ่มขึ้นองศารับภาพลดลง)

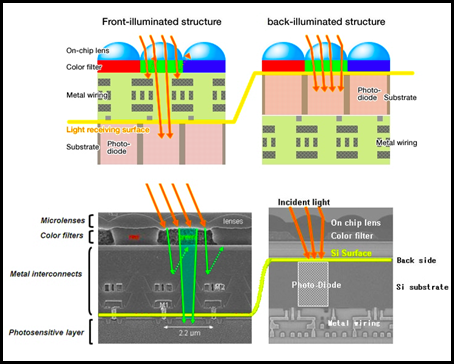

ส่วนของ Image Sensor ของ iPhone 4S เป็น CMOS Backside illumination ให้ขนาดของภาพที่ 8 Megapixel (3264x2448 pixel) โดย Back-side illumination (BSI) นั้นเป็นการให้ Photodiode สลับมาอยู่ด้านบน ทำให้แสงสามารถตกลงบน Photodiode ได้ดีกว่าเดิม

รูปจาก i-micronews.com

ซึ่งขนาดของ Image Sensor ของ iPhone 4S นั้นมีขนาดอยู่ที่ 4.54 x 3.39 mm^2 (5.67 mm diagonal) ซึ่งเท่ากับของ iPhone 4 โดยถ้าเทียบกับกล้อง Film (Full-frame พวก SLR หรือ DSLR) ขนาด 35mm จะได้ crop factor ที่ 7.64x ถ้ามานั่งคำนวณต่อว่าจะได้ความชัดลึก-ชัดตื้นเท่าไหร่ (Depth of field/DOF) ด้วยชุดเลนส์ที่ให้รูรับแสงกว้างถึง f/2.4 และทางยาวโฟกัสที่ 4.3mm ถ้าเทียบกับกล้อง Film (SLR หรือ DSLR) ขนาด 35mm จะได้ทางยาวโพสกัสที่ 33mm และค่าของรูรับแสงที่ f/22 เพราะฉะนั้นจะหน้าชัดหลังเบลอแบบเอาไปเทียบกับ SLR/DSLR คงทำได้ไม่ดีนัก เพราะปัจจัยในการได้ภาพแบบหน้าชัดหลังเบลอนั้นไม่ใช่แค่เลนส์แล้วจบ แต่มันเกี่ยวกับขนาดของ Image Sensor เข้ามาเกี่ยวข้องด้วย

แต่ทาง Apple ไม่ได้ระบุว่า ISO และ Speed Shutter เท่าไหร่ แต่คิดว่าถ้าบอกว่าสว่างขึ้นและเร็วขึ้นจาก iPhone 4 เพราะฉะนั้นลองเอามาเทียบๆ กับ iPhone 4 ที่สามารถใช้ ISO 80-2000 และ Speed Shutter 1/1000sec นั้นอาจจะถ่ายภาพด้วย ISO ที่สูงขึ้นได้อีกและ Speed Shutter และ Frame per Second ที่ดีมากขึ้นด้วย

ส่วนที่น่าสนใจคือ Hybrid IR Filter ที่เป็นการกรองคลื่นแสง Infrared ในแสงธรรมชาติหรือแสงจากแหล่งอืนๆ เพื่อให้สามารถถ่ายภาพได้สีสดใสมากขึ้น (ปรกติพบอยู่ในกล้อง DSLR เป็นปรกติอยู่แล้ว)

สุดท้าย Apple A5 ที่ออกแบบและพัฒนาตัว Image Signal Processor (ISP) ไว้ใน CPU ตัวนี้ เป็นอีกปัจจัยนึงที่ทำให้ภาพนั้นมีคุณภาพดีขึ้น ควบคุมโทนสีต่างๆ และความคมชัดที่ถูกปรับแต่งผ่าน Image Processor นั้นถูกตาถูกใจคนใช้งานได้มากขึ้นด้วย โดยเฉพาะในโหมดของ HDR ที่ปรกติจะเป็นการถ่ายภาพ 3 ภาพใน Exporsure ที่แตกต่างกันและนำมาทำ Tone Mapping เพื่อให้ได้ Dynamic Range ของภาพที่มากขึ้นกว่าถ่ายภาพปรกติ

อีกอย่างที่น่าสนใจคือ Apple ใช้ ISP บน A5 ในการปรับแต่งภาพให้ได้สมดุลสีขาว (White Balance) ที่ถูกต้องมากขึ้นอีก 28% และรองรับ Face Detection ในตัวไปเลย (ใช้ Apple A5 ในเรื่องการถ่ายภาพคุ้มค่ามาก)

ซึ่งเจ้า Image Processor ที่ที่กล่าวมานั้นมีอยู่เป็นเรื่องปรกติในวงการถ่ายภาพด้วยระบบ Digital อยู่แล้ว จึงไม่ใช่เรื่องใหม่แต่อย่างใด แต่ละค่าย แต่ละยี่ห้อก็จะมีสูตรและวิธีคิดปรุงแต่งตัวภาพที่ได้จาก Image Sensor ที่แตกต่างกันไปตามเอกลักษณ์ของแต่ละค่ายนั้นเอง (ขอไม่พูดถึงไฟล์แบบ RAW Format เดี่ยวจะงงไปใหญ่)

สุดท้ายเหมือนเป็นของแถมจากการใช้ CPU ที่เร็วขึ้น และด้วยการที่พัฒนา Apple A5 ให้มี ISP ที่ดีขึ้น ทำให้สามารถถ่ายรูปแรกนับตั้งคลิ้กเริ่มถ่ายได้ในเวลาเพียง 1.1 วินาที และรูปต่อมาในเวลาเพียง 0.5 วินาที โดยที่สามารถถ่ายวิดีโอขนาด 1080p บน iPhone 4S ได้อีกด้วย

Comments

บทความสุดยอดมากครับ ต้องมีความรู้พื้นฐานพอสมควรถึงจะอ่านเข้าใจ เพราะอุดมไปด้วยศัพท์ทางเทคนิค แต่ถือเป็นบทความที่รวบรวมความรู้ และให้ความรู้ทางเทคนิคได้ดีมากๆ อ่านแล้วชอบมากครับ

สำหรับคนที่งง สรุปสั้นๆ คือ กล้องมันให้คุณภาพของภาพที่สุดยอดมากครับ ผมเห็นตัวอย่างภาพที่ได้แล้วรีบไปกินยานอนหลับเลยครับ จะได้ฝันถึงว่าสักวันแอนดรอยด์จะมีกล้องเมพๆ แบบนี้บ้าง

ปล.คำผิด / ตัวอักษรเล็กใหญ่เยอะอยู่ครับ

ไปซื้อของ Sony Erisson น่าจะได้ครับ

I need healing.

ด้วยเทคโนโลยีกล้องที่มีอยู่ในมือ Sony สามารถทำให้ SE ทำได้เช่นกันครับ

แต่ SE จะเอามาใส่รึเปล่านี่ไม่อาจคาดเดาได้

จริงๆกล้องของ SE มันก็ดีมาแต่ไหนแต่ไรแล้ว อาจจะมีอะไรดีๆแบบนี้ซ่อนอยู่แต่ไม่ได้เปิดเผยข้อมูลโฆษณามากสักเท่าไร

Sony Ericsson Xperia Arc ไงครับ ^^

ตัวนี้ใช้เทคโนโลยีดี แต่ภาพออกมาไม่ได้เรื่องเลย เสียชื่อ exmor มากๆ

สงสัย image processor ไม่ถึงขั้น

ถูกครับ กล้องของ SE ทุกรุ่นตอนนี้ อยู่ในเกณฑ์ดี แต่ก็ดีไม่พอนะ ผมว่า SE ทำได้ดีกว้านี้ครับ

ผมเข้าใจว่า Apple ให้ Sony ผลิต Sensor ตัวนี้ให้นะครับ และถ้าผมเข้าใจถูก Xperia arc ใช้ Sensor ตัวเดียวกันนี่แหละครับ ภาพออกมาสวยไม่น่าแพ้กันครับ (ผมยังไม่ได้ลองดูภาพ full-res จาก iP4S เลยยังไม่อยากออกความเห็นหนักแน่นว่าเสมอกันจริงหรือไม่) แต่ที่พูดได้อย่างหนึ่งคือผมใช้ X arc มาจะครึ่งปีแล้ว ไม่เคยผิดหวังเรื่องกล้องจริง ๆ ครับ

twitter.com/exfictz

นี่ครับ ภาพจาก iPhone 4S

เจดโด้ นี่มันสุดยอดมากเลยครับ

ขอภาพจาก Arc มาเทียบเลยครับ

บทความละเอียดมากเลย ขอบคุณมากครับ

ชอบบทความมากครับ ถึงแม้จะไม่มีความรู้เรื่องกล้อง

มีรายละเอียดมาก @,@ แต่ก็ชอบอ่าน

และ ขอบคุณสำหรับบทความดีๆ

คุ้นๆ การฝัง(Call API?) DSP ใน CPU Apple ได้ครองสิทธิบัตรตัวนี้ไปแล้ว?

เทียบ nexus s ก่ะ ไอสี่ nexus s ภาพคมชัดกว่าแฮะ

แต่ไอโฟนสี่นี่รัวภาพได้สะใจมาก กดรัวๆๆๆๆ ได้เลย ไม่มีเพลงฮิตของวง room39

เหนี่ยว?

หน่วง

ตึกโป๊ะ..

ขอบคุณครับ ฮ่า ฮ่า

ธาตุไฟ เข้าแทรก ตู้ม!

ยังงงๆเรื่อง backside illumination sensor อยู่นิดหน่อย

DSLR, compact ทั่วไปทุกวันนี้ยังใช้เซ็นเซอร์แบบ frontside illumination อยู่ใช่มั้ยครับ

ถ้า backside illumination แบบนี้รับแสงได้ดีกว่าทำไมอย่าง canon ที่มีเทคโนโลยีทั้งเซ็นเซอร์ ทั้งชิป(ที่น่าจะล้ำกว่า) เป็นของตัวเองถึงยังไม่เปลี่ยนมาใช้กัน

หรือว่ามันผลิตได้แต่เซ็นเซอร์เล็กๆ? หรือถ้ามีขนาดใหญ่แล้วมันให้ผลลัพธ์ที่ไม่ต่างกัน?

@mamuang

เป็นสิทธิบัตรของ Sony Corporation ครับ

Sony ใช้ชื่อ Technology ว่า Exmor R ครับ (US patent 7521335) ซึ่งไม่แน่ใจว่าเป็น Sensor ตัวเดียวกับที่ Sony ผลิตหรือเปล่า และ HTC EVO 4G ก็ใช้ Sensor ลักษณะนี้เช่นกันครับ

ปล. Sony เป็นบริษัทที่เก่งทางด้านการทำ Sensor กล้องมาก มีสิทธิบัตรมากมาย บริษัทเกี่ยวกับกล้องถ่ายรูปขนาดใหญ่นักใช้ Sensor จากบริษัทนี้เพื่อมาทำงานร่วมกับเลนส์และ Image Processor ของตัวเอง ซึ่งตัวอย่างง่ายๆ ที่รู้จักกันก็คือ Nikon นั้นเอง (กล้อง Nikon D90 ใช้ Sensor ของ Sony ทำงานร่วมกับ Image Processor ชื่อ Expeed ของ Nikon เอง)

+1

เห็นภาพจาก NEX ตัวใหม่ๆแล้วตาลุกวาวทุกที >.<"

งั้น sony nex5 ของผม ที่บอกว่าใช้ Exmor R ก็เป็น backside illumination ด้วยเปล่าครับ

ว่าแต่ช่วยแนะนำการใช้ HDR หน่อยครับ มีnex5 แต่ใช้ mode นี้ไม่เป็นครับ

NEX-5 นี่ผมไม่แน่ใจครับผม ส่วน HDR ในกล้องระดับคนใช้ทั่วไปน่าจะถ่าย shot เดียวแล้วเดี่ยวตัวกล้องจะจัดการเองแหละครับผม

Sony ไม่ได้ถือวิทธิบัตรนี้ครับ Omni Vision เป็นคนคิดและถือสิทธิ์ครับ

US patent 7521335 << ลองอ่านดีๆครับว่าเขาถือสิทธ์เรื่องอะไรกันแน่ ...ผมว่าในสิทธิบัตรนี้ เขาไม่ได้บอกว่าเขาคิด(หรือถือสิทธิ์) BI นา

ขออนุญาตถามความรู้เรื่อง ตัวคูณซักเล็กน้อยด้วยนะครับ

เท่าที่เห็นใน web ต่างชาติ เขาบอกว่า iPhone4S เนี้ย เลนส์เขา 4.28mm และเมื่อเทียบกับ film135 ก็จะได้ องศารับภาพเท่ากับเลนส์ 35mm

นั้นแปลว่าตัวคูณน่าจะเป็น 8 กว่าๆนะ ไม่ทราบผมคิดอย่างนี้ถูกหรือเปล่า?

ผมอ่าน และถือตาม Assignee นะครับ อาจจะตีความคนละแบบ ขอบคุณที่ท้วงติงครับ

ส่วนเรื่องคูณนั้นผมตีความ 4.3mm ที่เป็นตัวใหม่ เนืองจากผมหาข้อมูลส่วนนี้เพื่อความแน่ใจก่อนว่ามันเท่าไหร่แน่ มีหลายแหล่งบอก 4.3mm และ 4.28mm บางที่ยังไปถึง 4.4mm แต่ผมเจอ 4.3mm เยอะกว่า และอ้างอิงจากข่าวลือก่อนหน้านี้จาก flickr ด้วย เพราะฉะนั้นจึงใช้ 4.3mm เป็นหลัก ส่วนตัวคูณ 7.64x ผมใช้ตาม iPhone 4 ที่เป็นตัวเก่าครับ เพราะขนาด sensor เท่ากัน

จริงๆ เทคโนโลยีนี้ยังใหม่มากนะครับ กล้องตัวแรกที่ใช้ระบบนี้เพิ่งเปิดตัวไปปีเดียวเอง

เหตุผลที่ไม่ถูกใช้ในกล้องใหญ่ คือ มันยังผลิตค่อนข้างยากครับ ถ้าผลิตเซนเซอร์ใหญ่ๆ จะให้ yield rate ต่ำมาก (แค่เซนเซอร์ฟูลเฟรมตอนนี้ก็มี yield rate ค่อนข้างต่ำแล้วครับ) แล้วก็ มันคงไม่มีผลมากนักต่อภาพ (ถ้าคิดในกรณีกล้อง DSLR) เพราะขนาดแต่ละพิกเซลของเอสแอลอาร์ใหญ่กว่ามาก รับโฟตอนได้ดีกว่า การพัฒนาส่วนนี้จึงจะให้ผลลัพธ์ที่ดีขึ้นในกรณีแสงน้อยมากๆ เท่านั้น

เอาจริงๆ ถ้านับแค่เรื่องแสงน้อย กล้องปัจจุบันนี้ไปเกือบสุตลิมิตของธรรมชาติแล้วละ (Canon 1D4, Nikon D3s)

ใช่แล้ว เป็นเทคโนโลยีที่ออกมาได้ประมาณ 3 ปีแล้ว และมีหลายบริษัทพัฒนาโดยใช้พื้นฐานนี้อยู่หลายๆ ยี่ห้อเช่นกัน แต่อย่างที่บอกมาเลยครับ กล้องที่ผลิตและใช้เทคโนโลยีนี้ก็เพิ่งได้ขายกันปีกว่าๆ เอง เพราะฉะนั้นมันเลยเหมือนของใหม่ แต่ก็เริ่มๆ มีการปรับเปลี่ยนกันบ้างแล้ว และที่ใช้ในกล้องโทรศัพท์มือถือกัน และดูเป็นตัวชูโรงเพราะขนาด sensor มันเล็กครับ มันเลยต้องใช้อะไรที่ลดการสูญเสียแสงให้ได้มากที่สุด ^^

กล้อง compact ตัวใหม่ๆ ของ nikon ก็ใช้ back-lit หมดแล้ว

แล้วก็กล้อง canon ตระกูล hs ทั้งหลาย

โอวว ขอบคุณทุกคนมากครับบบ :D

@mamuang

Canon มีครับหลายตัวด้วย ตรพกูล HS หรือเอาชัดๆ ที่ Canon โปรโมทเลยก็ Canon S95 ใช้ Sensor ชนิดนี้ครับ

คุณภาพเห็นผลดีขึ้นชัดเจนในพวกเซ็นเซอร์เล็ก ...พวกเซนเซอร์ใหญ่ มีวิธีการพัฒนาให้ภาพดีขึ้นแบบอื่นที่ถูกกว่า

เห็นกล้อง i4S มาจาก Sony จริงปะ กล้องเลยเมพขนาดนี้ ???

อ่านแล้วงงไป 18 ตลบ... เอาละ ต้องให้พี่กู(เกิล) ช่วยแล้ว - -

เขียนได้ดีมากครับ

ยังไม่ทันอ่านเลยครับ แต่รู้ว่าท่านเก่งมาก ^^ (ค่ำๆมาอ่าน)

lens 6mm ตัวคูณ 5.67 ได้ช่วง 35mm พอดีเลย

สู้ Nokia N8 ได้ยังหว่า

ตัว Image Sensor ของ N8 ยังใหญ่กว่า(เยอะ)ครับ (1/1.83")

^^ กระจ่างครับ เขียนได้ดีมากเลย

ถามผู้เขียนหน่อยครับ

คือเห็นรูปในเวป Apple แล้วมันสุดยอดเวอร์มากๆๆ

อยากถามความเห็นว่าใช้จริง user ทั่วไป

จะออกมาต่างจากรูปที่เขาแสดงมากน้อยแค่ไหนครับ

ประสบการณ์ผมซื้อ DSLR ดู Review แล้ว

รูปที่ถ่ายสุดยอดมากๆ ซื้อมา ถ่ายเอง

ดีกว่า digital ตัวเก่าหน่อยเดียว T T

คนทั่วไปไม่มีความรู้ด้านถ่ายภาพ ไม่เข้าใจองค์ประกอบศิลป ถ่ายมาก็น่าเหมือนๆปกติที่ถ่ายกับกล้องมือถืออื่นๆครับ อาจจะคมกว่า นิ่งกว่านิดหน่อยเพราะความไวชัตเตอร์ช่วย

อีกจุดขายสำคัญของ Apple คือ User Friendly มากๆ เรื่องกล้องก็คงจะเหมือนกัน แต่เดี๋ยวเครื่องออกก็คงมีรีวิวมาเองครับ กว่าจะเข้าไทยอีกนาน

เทียบว่าภาพพวกนั่นคือสวยสุดที่สามารถถ่ายได้ดีกว่า คนทั่วไปก็ถ่ายได้ตั้งแต่ห่วยๆ ถึงไม่เกินนั้น แต่เวลาไปเจอเพื่อนเก่าหรืองานสังสรรค์ ช่วงถ่ายรูปเยอะๆ เนี่ย iPhone จะกินเพราะถ่ายได้เร็วมากตั้งแต่ iPhone 4 ละ แถมคุณภาพออกมาจัดว่าดีเลย

อคติทำให้คนรับเหตุผลด้านเดียว

จากที่เคยลองใช้กล้องจากมือถือหลายๆ รุ่นผมบอกได้เลยว่ามือถือที่ชูโรงเรื่องกล้องส่วนใหญ่ถ่ายได้แบบภาพตัวอย่างแน่นอนครับ แต่ว่าต้องอาศัยฝีมือสักหน่อยครับ อาจจะไม่ง่าย แต่ก็ไม่ยากจนเกินไปครับ

ย่อหน้าที่ 7 จากท้ายสุด

Deep of Field เป็น Depth of field หรือเปล่าครับ

เสริมอีกเรื่อง เรื่องถ่ายวีดิโอ เค้าใช้ไจโรมาช่วยแก้ปัญหาการประมวลผลภาพสั่นไหวด้วยนะครับ

อ่านรู้เรื่อง นิด ๆ (>_<)

ข้อแย้งนิดนึงนะครับเรื่อง ISP ในชิบ A5 ถ้าไปดูจากหน้า http://www.apple.com/iphone/built-in-apps/camera.html ตรง A5 เค้าบอกว่า ISP นี่ช่วยทำให้กล้องทำงานได้เร็วขึ้นเฉยๆ แต่ในเรื่องของสีสันและ white balance นั้นเป็นหน้าที่ของ algorithms ใน iOS5 ถึงแม้จะใช้คำว่า "ปัจจัยนึง" ผมก็ยังไม่เห็นด้วยอยู่ดีเพราะหากอ้างตามเนื้อหาที่อ่านในหน้าเว็ป apple นั่นย่อมหมายความว่าถ้าเอา iOS5 ไปลงกับอุปกรณ์รุ่นอื่นๆก็ควรจะได้ algorithms ที่ดีขึ้น แต่ ISP นั้นมาช่วยเรื่องความรวดเร็วในการทำงานเท่านั้นเองครับ ซึ่งทำให้มันต่างจาก Image processor ของ DSLR พอสมควร

ขอบคุณสำหรับบทความครับ

ขอบคุณสำหรับความรู้มาก ๆ ครับ

อืม iPhone 4S pixel เท่า 350D ของผมแล้ว (8M Pixel เท่ากัน)

รูป Sample ของ iPhone 4S สวยจริงๆ แต่อยากเห็นแบบแสงน้อยๆมากกว่า

เลนส์เทพ Sensor เทพ มันต้องแสดงให้เห็นเวลายากลำบากเช่นแสงน้อยๆครับ

อีกเรื่องที่กล้องมือถือยังสู้กล้อง Digital หรือ DSLR ไม่ได้คือ ด้วยความที่ขนาด Sensor เล็ก DOF มันจึงลึก มิติที่ได้มันจึงแบนกว่าครับ

อีกเรื่องที่อยากรู้คือ การเอา sensor ในกล้องมาช่วยแก้ปัญหาเรื่องภาพเบลอ มันช่วยยังไงครับ

เพราะไม่ได้กันสั่นที่ lens หรือ sensor ใช้ image processing เอาหรือยังไงครับ