เดือนที่แล้วมีข่าวใหญ่เรื่องพนักงานกูเกิลคนหนึ่ง Blake Lemoine พบว่าโปรเจค AI LaMDA พัฒนาจนมี "ความรู้สึก" (sentience) ของตัวเอง เขาถึงขั้นให้สัมภาษณ์ว่าเขาเชื่อว่า LaMDA เป็นบุคคลจริงๆ ("I legitimately believe that LaMDA is a person.")

การให้ข่าวของ Lemoine อาจผิดกระบวนการไปหน่อยเพราะไม่ได้ขออนุญาตต้นสังกัดก่อน และเป็นข่าวที่สร้างความแตกตื่นไปทั่วโลก จนกูเกิลต้องออกมาแก้ข่าวในภายหลัง

ล่าสุดมีรายงานว่า Lemoine โดนไล่ออกแล้ว โฆษกของกูเกิลชี้แจงว่าคำกล่าวอ้างของ Lemoine ไม่เป็นความจริง และพูดคุยเป็นการภายในกับเขามาหลายเดือนแล้วแต่ไม่เป็นผล สุดท้าย Lemoine ก็ยังละเมิดกฎของพนักงานและนโยบายด้านข้อมูลของบริษัท จนทำให้ถูกปลดออก

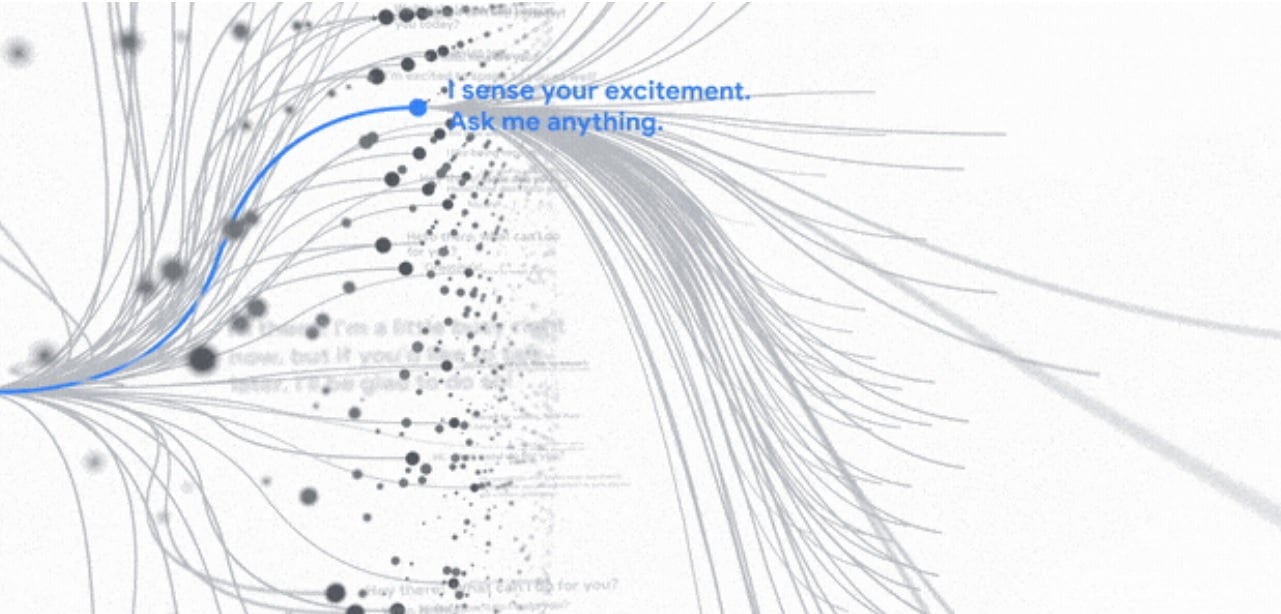

ตอนงาน Google I/O 2022 กูเกิลมีแผนเตรียมเปิด LaMDA ให้เล่นกันผ่านหน้าเว็บ AI Test Kitchen แต่การมีข่าวของ Lemoine ก็อาจทำให้แผนต้องเลื่อนออกไป (ใครอยากดูการโต้ตอบของ LaMDA ลองดูตัวอย่างในหน้าเว็บได้)

คลิปเปิดตัว LaMDA 2 ที่งาน Google I/O

Blake Lemoine ให้สัมภาษณ์กับ Bloomberg

ที่มา - Engadget

Comments

ไล่ออกเพราะดื้อไม่ฟังหัวหน้าสั่ง?

เค้าจ้างให้มาทำงานให้ เมื่อดื้อไม่ทำตามสั่งเค้าก็เลิกจ้าง ตรงไปตรงมาครับ

เป็นผมก็ไล่ออกมีแบบไหนเอาข้อมูลของบริษัทมาเผยแพร่เขาจ้างมาให้ทำงานไม่ใช่เผยแพร่ข้อมูลบริษัท

ไล่ออกเพราะอะไร เพราะเป็นเรื่องจริง หรือเป็นเรื่องไม่จริง หรือเรื่องจริงที่ควรเก็บเป็นความลับบริษัท

ตรงๆครับ เอาข้อมูลบริษัทมาเปิดเผย ไม่เกี่ยวกับเรื่องจริงเรื่องไม่จริง

ข่าวนี้เป็นการชี้จุดอ่อนของ Turing test ว่าการที่มนุษย์แยกมนุษย์กับ AI ไม่ออก ไม่ใช่เรื่องสำคัญอย่างที่คิด กลับกัน Reverse turing test กลายเป็นสิ่งสำคัญกว่า เพราะถ้า AI สามารถแยกระหว่าง AI กับมนุษย์ออกจากกันได้ เราก็จะได้ระบบ CAPTCHA ที่ดี

น่าคิดดี

ไล่ออกเพราะ "ก็ยังละเมิดกฎของพนักงานและนโยบายด้านข้อมูลของบริษัท จนทำให้ถูกปลดออก" สำหรับหลายท่านที่ยังข้องใจ ระเบียบและนโยบายก็เหมือนกฎหมายภายใน ซึ่งโดยปรกติแล้วจะมีการอ้างอิงในสัญญาจ้างงานเพื่อให้มีผลในทางปฏิบัติ

ส่วนเรื่องทำได้จริงหรือไม่ ส่วนตัวคิดว่าทำได้จริง เพราะอารมณ์ของมนุษย์สามารถประเมินจากปัจจัยรอบๆ ตัว และข้อมูลที่เรียกใช้งานได้ เข้าสมการสถิติก็น่าจะรู้อารมณ์และการตอบสนอง หรือสร้างความรู้สึกเสมือนได้ เพียงแต่อาจยังไม่ได้ซับซ้อนเท่ามนุษย์ เพราะเรายังไม่สามารถพัฒนา Sensor ที่มีรายละเอียดเท่ากับประสาทสัมผัสของมนุษย์

ตอนนี้ผมเองก็กำลังคิดว่าจะลองอ่าน Your Boss Is an Algorithm ว่าแนวคิดในอนาคตของการทำงานของคนจะเป็นยังไงเหมือนกัน

เรื่องจริงจะเป็นอย่างไรอันนี้ก็เรื่องนึง แต่เรื่องเอาข้อมูลภายในบริษัทมาเผยแพร่โดยไม่ได้รับอนุญาตจนบริษัทต้องเสียหาย ผมคิดว่าไม่โดนฟ้องเรียกค่าเสียหายต่อก็ดีแค่ไหนแล้ว แล้วตามข่าวก็ไม่ใช่ปุ๊ปปั๊ปไล่ออกแต่พูดคุยภายในกันแล้วด้วย

ถึงจะเป็นเรื่องจริงหรือไม่จริง แต่การเอาข้อมูลของบริษัทมาเผยแพร่โดยที่ไม่ได้รับอนุญาติมันไม่ได้นะ สมควรล่ะที่โดนไล่ออก

เขาไม่ฟ้องก็บุญแล้ว555

ส่วนตัวมองว่า ... ต่อให้ AI โต้ตอบด้วยคำพูดที่ "เหมือนจะมีความรู้สึก" มันก็เป็นแค่หนึ่งในคำพูดที่ถูกเทรนให้พูด ไม่ได้เกิดจากความรู้สึกของตัว AI เองอยู่ดี

ดังนั้นจึงคิดว่า นอกจากจะทำละเมิดกฎบริษัทแล้ว ยังเป็นการสร้างความเสื่อมเสียให้บริษัทอีกด้วย จะโดนให้ออกมันไม่ใช่เรื่องแปลก

เห็นด้วย ผิดเต็มๆ เอาข้อมูลมาเปิดเผย

แต่ ความรู้สึก มันก็คือการแสดงออก คนเข้าอกเข้าใจกัน เพราะ คนเข้าใจความรู้สึกกัน คนไม่เข้าใจความรู้สึก AI เพราะเข้าใจว่ามันคือค่า weight หลายๆค่า แต่ถ้ามองกลับอารมณ์คน ก็มีขึ้นลง หลายๆ อย่างผสมกันอยู่เหมือนกัน

คนก็ถูกสอนให้พูดเหมือนกัน

ไม่แน่ใจว่าเทคนิค AI ตัวนี้น่าจะเรียนรู้ได้แต่เฉพาะตอนเทรน คือ ตอบไปตามที่เทรนมาสั้นๆก็คือแชตบอต

ส่วนคนสามารถเรียนรู้ได้ตลอด

คนนี้น่าจะโดนหลายเรื่องอยู่นะ ทั้งโปรเจคที่ยังไม่เปิดเผยออกสู่สาธารณะ เอาเรื่องภายในมาเปิดเผย เสียดายที่ Google ไม่ฟ้อง และน่าจะเสียอนาคตการทำงานเลยเพราะถ้ารับเข้ามาก็อาจโดนว่าจะเอาอะไรมาพูดอีก

ถ้ารู้จัก Turing test คงไม่แปลกใจกับบทสนทนาของ AI ตัวนี้

แสดงว่าโดน AI หลอกซินะ ฮ่าๆ

ยังกะหนัง Ex Machina ฮ่าๆ