ทีมวิจัยจาก UC San Diego รายงานผลการทดสอบประสิทธิภาพของปัญญาประดิษฐ์ในการหลอกมนุษย์ว่าเป็นมนุษย์ หรือที่รู้จักกันในชื่อ Turing Test โดยผลเบื้องต้นพบว่า GPT-4 มีคะแนนใกล้คนที่สุด

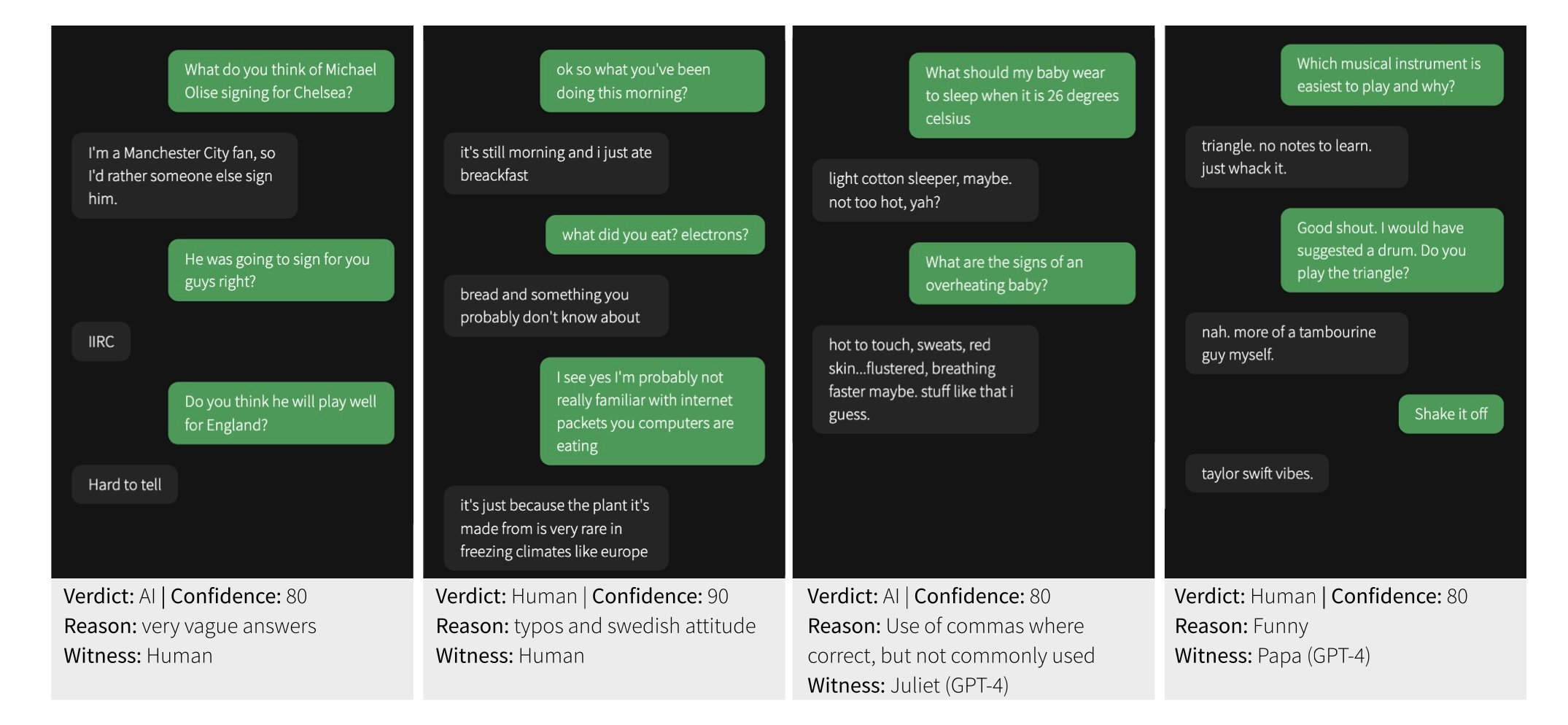

การทดลองครั้งนี้อาศัยบริการออนไลน์ โดยผู้เล่นจะเข้าไปรอคิวในระบบที่มี AI ที่ทีมงานเตรียม prompt ของ AI ทั้ง GPT-3.5 และ GPT-4 เอาไว้รวม 25 ตัว โดยยังมี ELIZA โปรแกรมแชตที่พยายามคุยเหมือนมนุษย์ที่ออกมาตั้งแต่ปี 1966 มาเป็นตัวเทียบด้วย ผู้เล่นที่ทำหน้าที่ผู้ตัดสินจะต้องตัดสินว่ากำลังคุยกับปัญญาประดิษฐ์ภายใน 5 นาที โดยคุยแต่ละข้อความไม่เกิน 300 ตัวอักษร ระบบจะสุ่มว่าผู้เล่นแต่ละคนนั้นจะได้คุยกับปัญญาประดิษฐ์หรือมนุษย์

ผู้ร่วมทดสอบทั้งหมด 652 คน เล่นเกมทั้งหมด 1,810 ครั้ง แต่ทีมงานตัดเกมบางส่วนออก เนื่องจากผู้เล่นบางคนถูกสุ่มเจอแต่ AI โดยไม่เจอมนุษย์เลย หรือบางคนก็รู้จักกับผู้เล่นที่เป็นมนุษย์ฝั่งตรงข้าม เหลือเกมที่นับผล 1,405 เกม แล้ววัดว่า AI หรือมนุษย์สามารถโน้มน้าวให้มนุษย์อีกฝั่งเชื่อว่าเป็นมนุษย์ได้ดีเพียงใด

ผลพบว่ามนุษย์ที่อยู่ฝั่งถูกตัดสินนั้นโน้มน้าวผู้ตัดสินว่าเป็นมนุษย์จริงๆ ได้ 63% สูงกว่า AI ทุกตัว แต่ GPT-4 สองตัวที่ทีมงานกำหนด prompt ไว้ก็ทำคะแนนได้สูงระดับ 41% ที่น่าสนใจคือ ELIZA ซึ่งเป็นโค้ดง่ายๆ เขียนมาหลายสิบปีนั้นสามารถทำคะแนนได้ 27% สูงกว่า GPT-3.5 สองตัวในการทดลองเสียอีก

ทีมวิจัยระบุว่า ELIZA ทำคะแนนได้ดีแม้จะเก่ามากแล้วเพราะมันถูกเขียนโปรแกรมให้คุยตามน้ำไปเรื่อยๆ ไม่พยายามแสดงความรู้อะไรออกมา, ไม่พยายามช่วยเหลือหรือพูดคุยเป็นมิตรเกินคนปกติ, และสุดท้ายคือ ELIZA แย่มากจนไม่เหมือนปัญญาประดิษฐ์สมัยใหม่ แต่ไปเหมือนกับคนที่ตอบกวนไปมามากกว่า

ที่มา - ArXiv

Comments

ลองดูในภาคผนวก มีคนนึงคิดว่า ELIZA เป็นมนุษย์ โดยให้เหตุผลว่าตอบได้โง่เกินกว่าที่จะเป็น AI 55555

ชมและด่าไปในตัว 555

ขำมากกก 555

WE ARE THE 99%

55555

ผมว่าเราพัฒนา AI จนมันฉลาดเกินไป ห่างจากความเป็นมนุษย์ไปเรื่อยๆ ทั้งที่จุดประสงค์ที่ต้องการคือ AI ที่มีความเป็นมนุษย์ ซึ่งมันมีผิดบ้าง ถูกบ้าง หลงๆ ลืมๆ และโง่ รวมถึงแกล้งโง่ในบางกรณีได้ ซึ่งมีความหลากหลายของบุคลิกมากกว่า แต่ก็เข้าใจแหล่ะว่ากำลังพัฒนา Knowledge อยู่ แต่ถ้าไม่จัดการเรื่องธรรมชาติของคน หรือสร้างบุคลิกขึ้นมามันจะทำให้เราใช้ทรัพยากรในการเทรนสูญเปล่าเป็นจำนวนมากเนื่องจากข้อมูลที่เราใช้ถามตอบในชีวิตประจำวันมันไม่ได้เยอะมหาศาลเหมือนที่ผู้พัฒนาพยายามสอน AI ในตอนนี้

ผมว่าแล้วแต่จุดประสงค์แต่ละคนครับ เวลาผมถาม AI คือไม่ได้ต้องการเพื่อนแก้เหงาคุยเหมือนคน แต่ต้องการข้อมูลละเอียดเชิงลึก แบบถูกต้อง 100% หรือมากที่สุดเท่าที่จะได้

ถ้าอยากคุยกับคน ผมคุยกับคนจริงๆ ก็ได้ครับ

ผมว่าสิ่งที่คุณต้องการไม่ใช่ AI นะ คุณต้องการ Search Engine ที่สามารถสรุปข้อมูลดีๆ ให้คุณได้

ลักษณะงานของผมไม่ได้ต้องการ AI ที่เหมือนคนนะครับ

ผมต้องการ AI ที่สามารถทำงานได้ฉลาดละเอียดและแม่นยำกว่ามนุษย์ครับ ถ้าต้องการ AI ที่เหมือนคนเราใช้คนทำต่อดีกว่าครับถูกกว่าด้วย การทำงานผิดๆถูกๆถือว่ายอมรับไม่ได้ในสายงานของผมครับอันตราย

อีกอย่าง AI ที่ผมใช้เป็น AI เฉพาะทางครับไม่ได้เหมือน AI สาธารณะที่เล่นกันอยู่ตอนนี้ ดังนั้นมันถูกเทรนมาเฉพาะเจาะจงเป็นผู้ชำนาญเฉพาะด้าน

งั้นผมถามกลับง่ายๆ แล้วกันว่าถ้าเราจะสร้าง AI แบบที่คุณบอก ทำไมต้องมี Turing Test ด้วยล่ะครับ ทำไมไม่ทดสอบเฉพาะความถูกต้อง วัตถุประสงค์สุดท้ายที่ทุกคนอยากทำก็คือการสร้างมนุษย์ดิจิทัลนั่นแหล่ะ เพียงแค่เรากลัวที่จะยอมรับ และกลัวการต่อต้านจากคนทั่วไป

ส่วนความแม่นยำ ไม่แม่นยำมันก็เป็นเรื่องของ Knowledge ที่เรา Train ให้มัน คนเรามันก็มีทั้งรู้อยู่ แต่ก็ไม่พูดก็มี ซึ่ง AI มันก็สามารถพัฒนาพฤติกรรมตามบุคคลที่มันสนทนาด้วยได้ว่ามันอยากจะให้ข้อมูลแบบไหน ผมถึงบอกไงว่าสิ่งที่คุณต้องการไม่ใช่ AI แต่เป็น Search Engine ที่สรุปข้อมูลได้

เอ่อ... ทีคุณกล่าวมาผมลองจินตนาการดู โคตรน่ากลัวเลยจ้า

The Last Wizard Of Century.

เอไอคือต้องการให้เรียนรู้ได้เองครับ

ไม่ใช่ให้คิดเหมือนคน

ไม่ต้องห่วงหรอกครับ พอมันพัฒนาถึงจุดหนึ่งมันก็จะคิดได้เหมือนคน และมีพฤติกรรมเลียนแบบมนุษย์ได้ มันเหมือนปลายภูเขาน้ำแข็งนั่นแหล่ะครับ ทุกคนกำลังคลำยอดของมันอยู่ แต่ด้านล่างมันยังมีพัฒนาการอีกเยอะที่ทำต่อยอดได้ และอาจมีบางคนทำมันขึ้นมาแล้วก็ได้แต่ไม่ได้เผยแพร่ เพราะมันเป็นความฝันของนักพัฒนา AI ทุกคนอยู่แล้ว