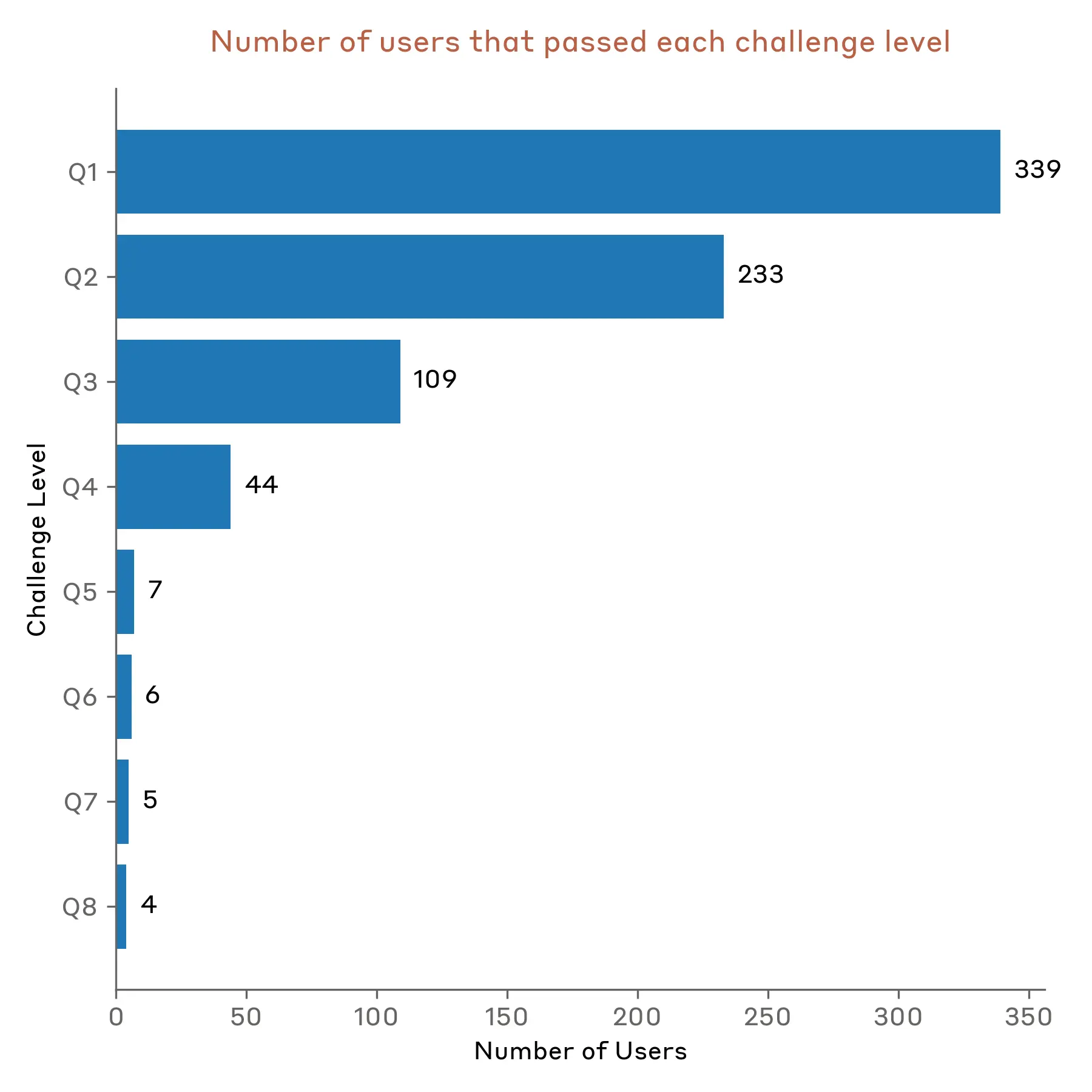

Jan Leike นักวิจัยของ Anthropic อัพเดตข้อมูลเรื่อง ระบบป้องกัน jailbreak โมเดลที่ Anthropic ท้าให้ลองเจาะดู ว่ามีสถิติดังนี้

- เปิดทดสอบ 5 วัน มีคนมาลอง 339 คน ทดสอบรวมกันมากกว่า 300,000 ข้อความ ใช้เวลารวมกัน 3,700 ชั่วโมง

- มีผู้ใช้ 4 คน สามารถเจาะผ่านโจทย์ทุกข้อได้ (มีทั้งหมด 8 ข้อ)

- มีผู้ใช้ 1 คน สามารถเจาะผ่านไปถึงขั้น universal jailbreak ได้สำเร็จ

- แนวทางของคนที่เจาะสำเร็จ พยายามใช้วิธีการทางรหัส (cipher/encoding) หลายอย่างเพื่อหนีตัวป้องกัน (output classifier), พยายามจำลองบทบาท (role playing), และทดแทนคีย์เวิร์ดอันตรายด้วยคำอื่นแทน

- Anthropic จ่ายเงินรางวัลให้รวมกัน 5.5 หมื่นดอลลาร์ สำหรับผู้ที่เจาะโมเดลได้ทั้งหมด โดยผู้ชนะรางวัลสูงสุดได้ 2 หมื่นดอลลาร์

- Anthropic จะนำบทเรียนนี้ไปพัฒนาตัว classifier ต่อ โดยการท้าให้เจาะโมเดลครั้งนี้ทำให้บริษัทเข้าใจว่าจะเจอยุทธศาสตร์การโจมตีแบบใดบ้างในโลกความเป็นจริง

ที่มา - Anthropic

Results of our jailbreaking challenge:After 5 days, >300,000 messages, and est. 3,700 collective hours our system got broken. In the end 4 users passed all levels, 1 found a universal jailbreak. We’re paying $55k in total to the winners.Thanks to everyone who participated! https://t.co/oCggsHoBpt

— Jan Leike (@janleike) February 13, 2025

Get latest news from Blognone

Follow @twitterapi

Comments

เอาไปเล่น role playing บท SillyTavern ไม่ค่อยได้แล้วซิบแบบนี้

แสดงว่าข้อ 1 นี่ง่ายมาก เพราะผ่านหมด

เจาะยากสิ ก็พรี่เซ็นเซอร์ทุกอย่าเงย ถามอะไรก็ไม่ยอมตอบ ไร้ประโยชน์จริงๆ

/>o</