ทีมวิจัย Microsoft Research เปิดตัวโมเดลภาษา BitNet ที่ขนาดเล็กพอจนสามารถรันในซีพียูได้

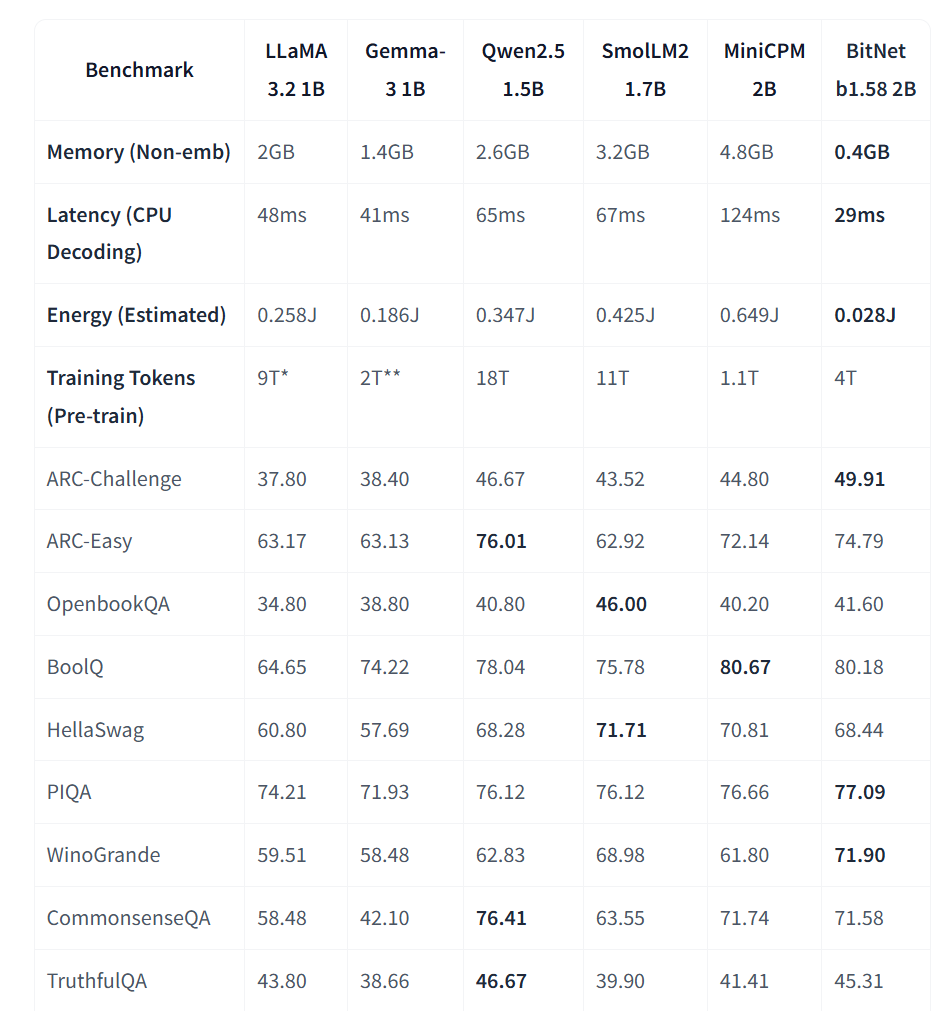

วงการโมเดลภาษา LLM รุ่นเล็กมีโมเดลหลายค่าย เช่น Llama ขนาดพารามิเตอร์ 1B และ 3B กรณีของ BitNet มีขนาดพารามิเตอร์ 2B และเทรนด้วยข้อมูลขนาด 4T (trillion tokens) แล้วถูกลดขนาดน้ำหนักข้อมูล (quantized) เพื่อให้ขนาดของโมเดลเล็กลง

จุดเด่นของ BitNet คือใช้เทคนิค quantization แบบ 1-bit (มีได้ 3 สถานะคือ -1, 0, 1) ตั้งแต่ตอนเทรนโมเดลเลย งานวิจัยนี้ต้องการพิสูจน์ว่าโมเดล 1-bit LLM ถ้าเทรนด้วยวิธีการที่ดีพอ ก็สามารถให้ผลลัพธ์ที่ดีไม่แพ้กับโมเดลที่ไม่ถูก quantized น้ำหนักได้

ขนาดที่เล็กของ BitNet ทำให้มันต้องการแรมแค่ 0.4GB น้อยกว่า Llama 3.2 1B ที่ใช้แรม 2GB หรือ Gemma 3 1B ที่ใช้แรม 1.4GB แต่ยังให้ผลลัพธ์ที่ดีพอๆ กัน และดีกว่าด้วยซ้ำในบางชุดทดสอบ แถมยังตอบเร็วกว่า มีค่า latency อยู่ที่ 29ms เทียบกับ Llama 3.2 1B ที่ใช้ 48ms

ตอนนี้ BitNet ยังมีสถานะเป็นงานวิจัย มีเปเปอร์เผยแพร่ เพื่อหาความเป็นไปได้ของการลดขนาดโมเดลลง เพื่อให้รันงานได้บนฮาร์ดแวร์ที่กว้างขวางมากขึ้น

ที่มา - Microsoft, TechCrunch

Comments

https://bitnet-demo.azurewebsites.net/

ก็ใช้ได้อยู่ ให้เขียนอะไรง่ายๆ เร็วๆ ไม่ซับซ้อนมาก แต่เรื่องภาษายังมีปัญหาเยอะพอสมควร

Hallucination มากกับภาษาไต

มือใหม่!! ใหม่จริงๆนะ

ยังใช้งานไม่ค่อยดีเท่าไหร่ แต่เป็นกำลังใจให้นะ

เท่จ๊าดดดดด